테슬라 로보택시가 보여준 미래, 그 핵심 기술은?

최근 테슬라는 자율주행 택시(로보택시) 서비스를 시범 운행하며, 자사의 기술이 실제 도로 환경에서도 안전하게 작동할 만큼 발전했음을 증명했습니다. 그렇다면 테슬라는 어떻게 차량이 주변 환경을 사람처럼 인지하고 주행할 수 있도록 했을까요?

업계에서는 2022년 CVPR 워크숍에서 발표된 Occupancy Network 연구를 주목하고 있습니다. 실제로 이 연구에는 테슬라 AI 팀 연구원들이 참여했으며, 영상 기반 입력을 통해 차량 주변의 3D 공간을 마치 ‘채워진 블록(Voxel)’처럼 인식하는 혁신적인 방법을 제시했습니다.

기존 자율주행 기술의 한계, 무엇이 문제였나?

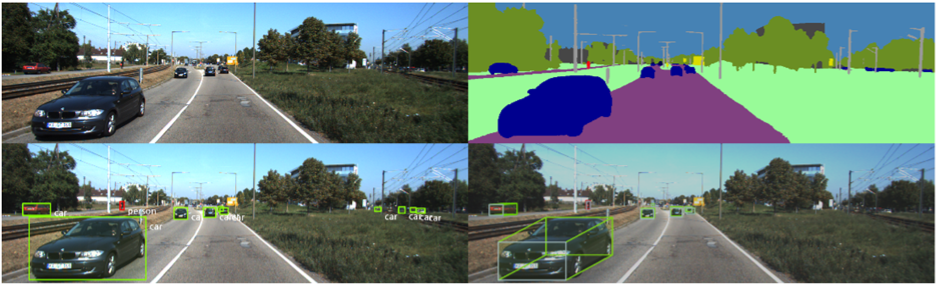

기존 자율주행을 위한 AI 모델추론 결과 예시 (왼쪽 아래: 2D Object Detection, 오른쪽 위: Semantic Segmentation, 오른쪽 아래: 3D Object Detection)

지금까지의 자율주행 기술은 주로 두 가지 방식에 의존해왔습니다:

– Bounding Box 방식의 한계

- 비정형 물체 취약 – 쓰러진 나무, 사고 잔해 등 예상치 못한 형태 인식 어려움

- 정밀도 부족 – 물체를 ‘네모 상자’로만 인식해 세부 구조 파악 불가

- 높이 정보 누락 – 육교, 터널 등 다층 구조 장애물 인식 실패

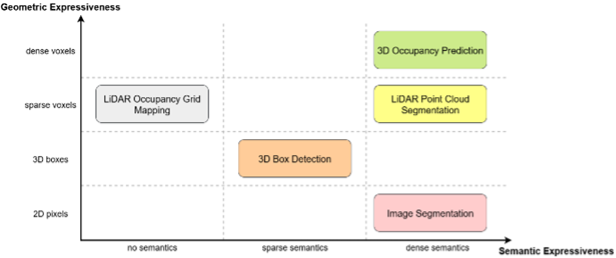

기존 자율주행 인식 방법과 3D Occupancy Prediction 공간적, 의미론적 정보 비교

2023 CVPR Workshop에서 발표한 내용에 따르면 기존의 방법들보다 3D Occupancy를 이용한 방법이 공간적, 의미론적 정보 모두 잘 담고 있다는 것을 발표했습니다.

한계를 극복하기 위해 등장한 것이 바로 3D Occupancy Prediction입니다.

이 기술은 Voxel 기반 접근법을 통해 3차원 공간을 더욱 정밀하게 모델링합니다.

3D Occupancy Prediction, 세상을 ‘마인크래프트’처럼 보다

마인크래프트 게임 속 장면

대표적인 예시로 마인크래프트는 Voxel을 활용해 게임 속 세상을 구성하고 제작하였습니다.

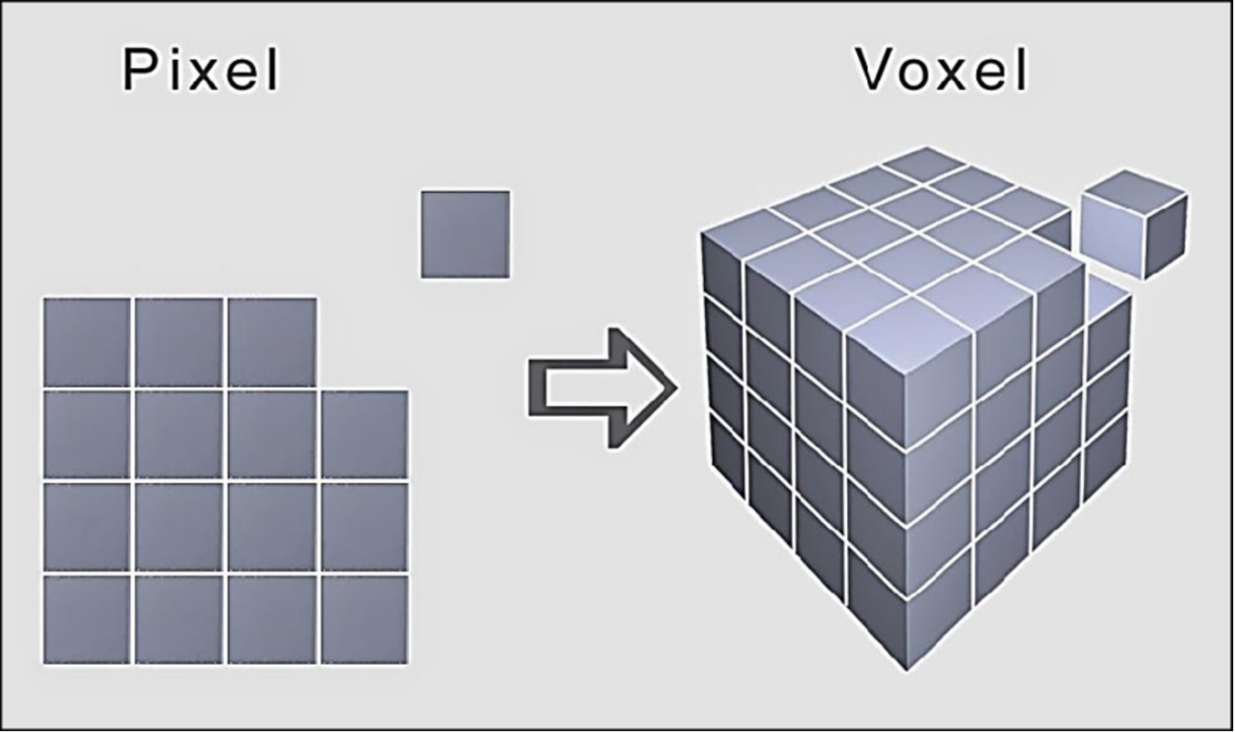

Voxel: 3차원 픽셀의 개념

마인크래프트 게임을 아시나요? 세상을 정육면체 블록으로 표현하는 이 게임처럼, Voxel은 3차원 공간을 작은 정육면체로 나누어 표현합니다.

- Pixel (2D): 평면 이미지의 점

- Voxel (3D): 공간의 부피를 가진 점

의료 분야에서 CT, MRI 촬영 데이터를 3D로 재구성할 때도 이 Voxel 기술이 활용됩니다.

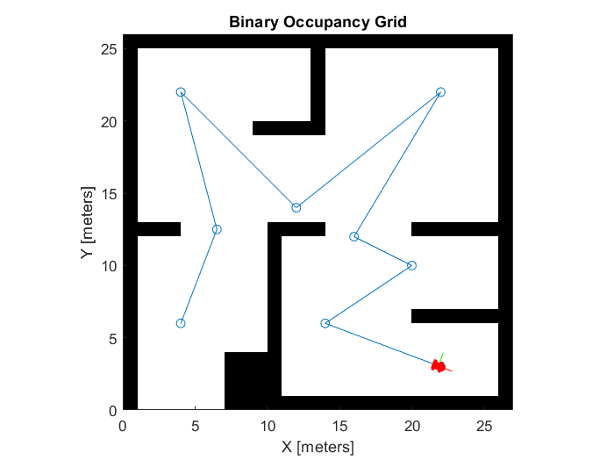

Occupancy Grid: 갈 수 있는 곳과 없는 곳을 구분

Occupancy Grid 시각화 (빨간색 : 로봇, 하늘색 : 로봇의 이동 경로)

로봇공학에서 유래한 이 기술은 공간을 격자로 나누고, 각 칸이 ‘비어있음’ 또는 ‘차있음’으로 표현합니다. 마치 체스판처럼 공간을 구획하고, 각 칸의 상태를 파악하는 것입니다.

예를 들어, Map에서 흰색으로 되어있는 Grid Cell은 장애물이 없는 Cell이고 검은색 Cell은 장애물이 있는 Cell로 표현이 되어 로봇이 장애물을 피하여 경로를 하늘색 선과 같이 생성할 수 있도록 Map에 저장합니다.

이를 3D 로 확장한 것이 Voxel 기반 Occupancy Grid입니다. 3D Occupancy Grid에서는 각 Voxel이 점유 유무로 표현되며 높이 정보와 객체의 내부 구조나 비정형 물체를 포착할 수 있기 때문에 정보 손실을 크게 줄입니다.

– 3D Occupancy Prediction의 혁신적 장점

- 완벽한 공간 인식 – 높이, 깊이, 너비를 모두 정밀하게 파악

- 숨겨진 영역 예측 – AI가 경험을 바탕으로 보이지 않는 곳까지 추론

- HD Map 의존성 탈피 – 사전 제작된 정밀 지도 없이도 자율주행 가능

- 실시간 적응력 – 공사 현장, 사고 현장 등 예상치 못한 상황 대응

글로벌 기업들의 경쟁, 누가 앞서가나?

– 주요 기업 동향

테슬라 (Tesla)

- Occupancy Network 데모 영상 공개

- 차량이 공간상의 점유된 지점과 Voxel이 속한 개체의 물체의 이동 방향까지 예측하는 ‘Occupancy Flow’ 기술 개발

엔비디아 (NVIDIA)

- Voxformer, FB-OCC 등 관련 기술 지속 발표

- Isaac Sim, Omniverse 플랫폼에 기술 통합

- 자율주행 로봇 데모에서 3D Occupancy Prediction 통하여 장애물 회피 성공 시연

영상 출처 : Nvidia. https://www.youtube.com/watch?v=w1EU3JT32Do

Nvidia 뿐만 아니라 3D Occupancy Prediction은 위에서 언급한 것처럼 테슬라, Waymo 등 빅테크 기업도 연구중인 분야이고 자율주행 로봇, 자율주행 자동차, 자율주행 드론 등 카메라로 세상을 인지하는 솔루션이 필요한 곳에 3D Occupacny Prediction을 활용할 수 있습니다.

공개 데이터셋 비교

자율주행 데이터셋에서 많이 활용되는 Kitti, Nuscenes, Waymo 또한 Occupancy Prediction을 위한 벤치마크 데이터셋이 존재합니다.

KITTI Semantic Scene Completion SCPNet 모델 내부 테스트

3D Occupancy Prediction 데이터셋 비교

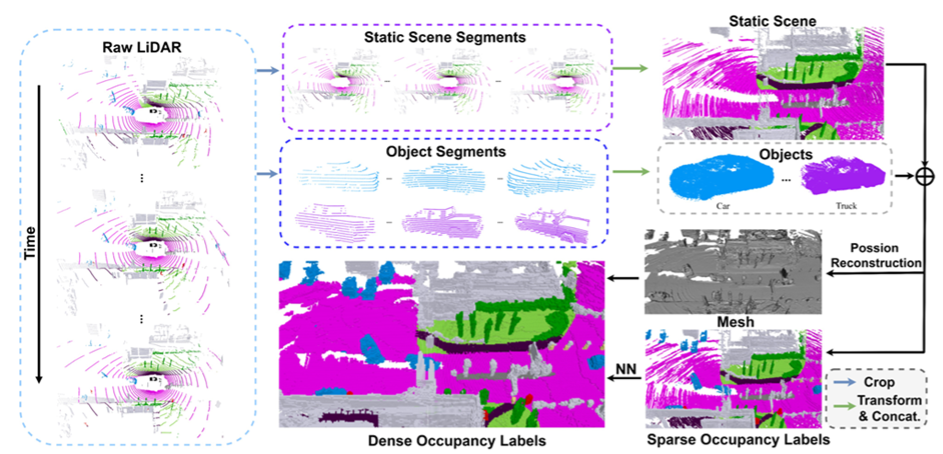

SurroundOcc 데이터 생성 파이프라인

| 구분 | SemanticKITTI | SurroundOcc | Occ3D |

| 기반 데이터 | KITTI | nuScenes | Waymo + nuScenes |

| 입력 방식 | 라이다 포인트 클라우드 | 360도 멀티 카메라 | 360도 카메라 |

| 특화 분야 | Semantic Scene Completion | 전방향 시야 처리 | 고해상도 정밀 표현 |

▶ 장점 비교

| 데이터셋 | 주요 장점 |

| SemanticKITTI | • 검증된 데이터셋으로 높은 신뢰성• 직접적인 3D 정보로 정확한 공간 인식• Semantic Scene Completion 연구에 최적화 |

| SurroundOcc | • 360도 전방향 시야 확보• 멀티 프레임 합성으로 데이터 밀도 향상• 정적/동적 객체 구분 처리 가능• Mesh Reconstruction을 통한 정교한 3D 표현 |

| Occ3D | • 두 대형 데이터셋 통합 활용• 가장 넓은 범위 커버• 최고 수준의 Voxel 해상도• 고급 노이즈 감소 기술 적용 |

▶ 단점 비교

| 데이터셋 | 주요 단점 |

| SemanticKITTI | • 동적 객체 처리 불가• 실시간 변화하는 물체 형상 포착 한계 |

| SurroundOcc | • 복잡한 데이터 생성 파이프라인• 프레임 간 위치 정보 의존성으로 인한 오차 누적 위험 |

| Occ3D | • 가장 복잡한 데이터 처리 과정• 고해상도/넓은 범위로 인한 높은 계산 비용 |

▶ 요약

| 특징 | SemanticKITTI | SurroundOcc | Occ3D |

| 복잡도 | 낮음 | 높음 | 매우 높음 |

| 정확도 | 보통 | 높음 | 매우 높음 |

| 처리 범위 | 낮음 | 높음 | 매우 높음 |

| 동적 객체 처리 | X | O | O |

| 계산 비용 | 낮음 | 보통 | 높음 |

▶ 선택 가이드:

- 기본 연구용: SemanticKITTI

- 실용적 360도 시야: SurroundOcc

- 최고 성능 추구: Occ3D

| 데이터셋 | Voxel 크기 | 인식 범위 | 동적 객체 | 입력 센서 |

| SemanticKITTI | 0.2×0.2×0.2m | 50×50×6.4m | X | 라이다 point cloud |

| SurroundOcc | 0.5×0.5×0.5m | 100×100×8m | O | 360° 카메라 |

| Occ3D | 0.1×0.1×0.2m | 160×160×12.8m | O | 360° 카메라 |

산업별 활용 가능성과 기대효과

– 자동차 산업

- 활용 – 완전 자율주행(Level 5) 구현

- 효과 – HD Map 구축 비용 절감, 돌발 상황 대응력 향상

– 로보틱스 산업

- 활용 – 물류 로봇, 서비스 로봇의 실내외 자율 이동

- 효과 – 복잡한 환경에서의 충돌 방지, 작업 효율성 향상

– 건설/중공업

- 활용 – 건설 현장 자율 중장비, 안전 모니터링

- 효과 – 사고 예방, 24시간 무인 작업 가능

– 드론/UAM(도심항공교통)

- 활용 – 도심 저공 비행, 장애물 회피

- 효과 – 안전한 도심 비행 경로 계획

AIWORKX의 차별화된 3D Occupancy 데이터 구축 기술

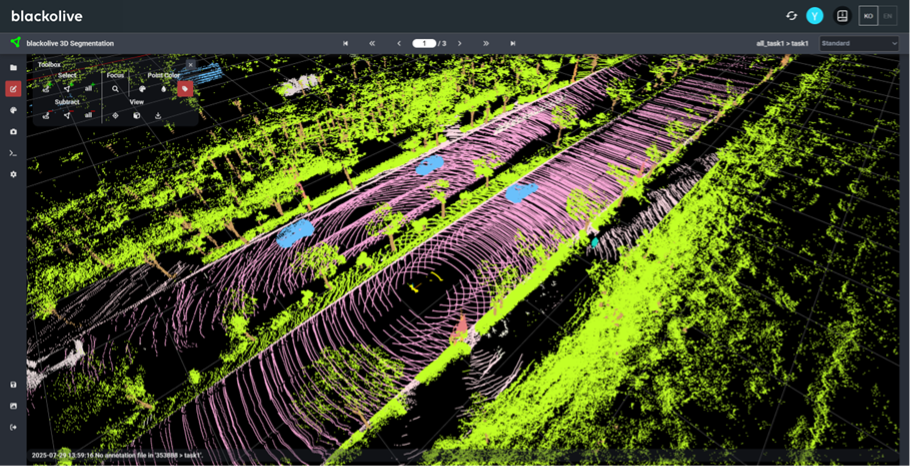

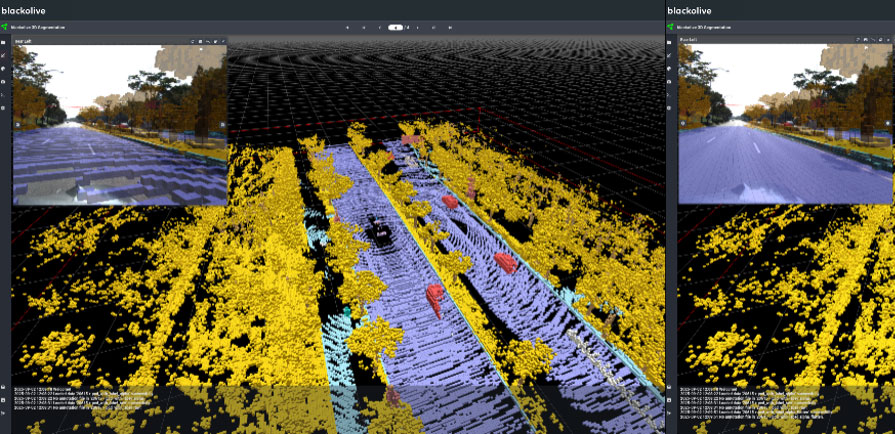

AIWORKX 레이블링 툴 blackolive 3D Semantic Segmentation 시각화

– 독자적 기술 파이프라인

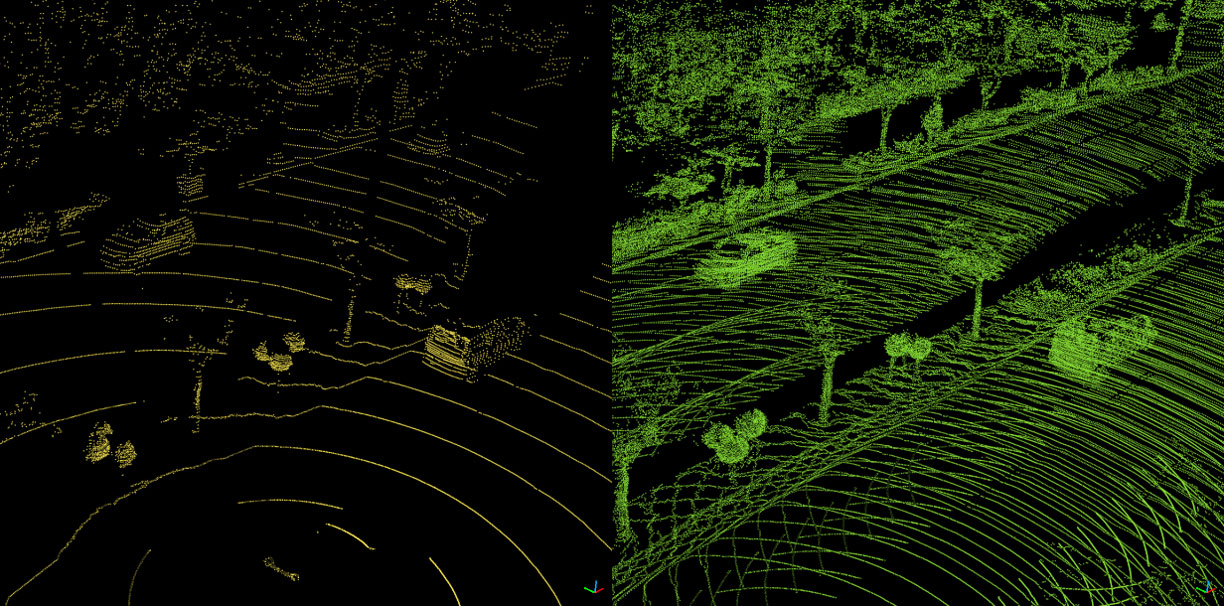

● 1단계: 고밀도 Point Cloud 생성

왼쪽 – 3D point cloud single frame. 오른쪽 : 3D dense point cloud

- 여러 프레임의 3D 데이터를 정밀하게 결합

- 단일 프레임 대비 10배 이상 밀도 향상

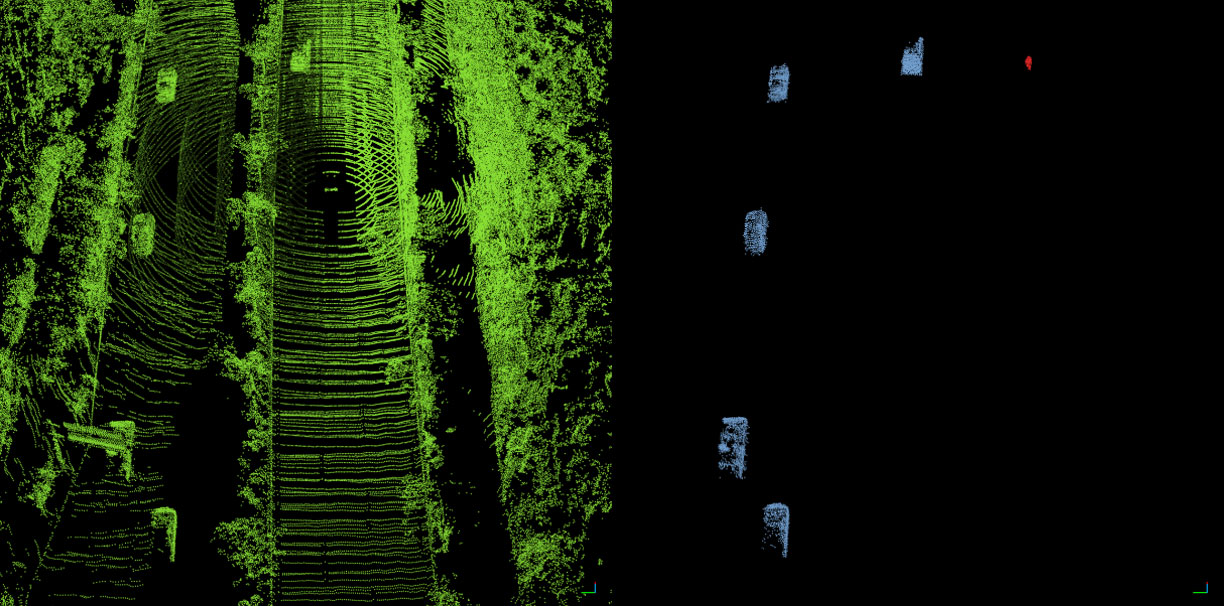

● 2단계: 동적 객체 정밀 처리Previous imageNext image

왼쪽 – 3D dense point cloud 오른쪽 : 동적 객체 3D point cloud (파란색 : 자동차, 빨간색 : 사람)

- 자체 개발 3D Object Detection & Tracking 모델 활용

- 움직이는 차량, 보행자의 정확한 형태 복원

● 3단계: 품질 고도화Previous imageNext image

왼쪽 – 기존 3D Occupancy data 오른쪽 : mesh reconstruction 및 평탄화 적용 data

- Mesh Reconstruction으로 데이터 밀도 추가 향상

- 바닥 평탄화 기술로 노이즈 제거

💻 blackolive 툴의 핵심 기능

AIWORKX 레이블링 툴 blackolive 3D Occupancy Prediction 시각화 (데이터 출처 : Naverlabs localization dataset)

- 직관적 레이블링– Brush, Polygon, Lasso 등 다양한 도구

- 효율적 작업 – Voxel 단위 Move, Copy, Paste 지원

- 정확도 향상 – 카메라 이미지와 실시간 동기화

- 작업 시간 단축 – 기존 대비 50% 이상 속도 향상

AIWORKX와 함께하는 3D Occupancy 혁신

AIWORKX는 단순한 데이터 레이블링을 넘어, 차세대 자율주행의 핵심 인프라를 구축하고 있습니다.

팀원, Vision AI팀

유지형

광운대학교 전자통신공학과 학사

광운대학교 전자통신공학과에서 인공지능을 활용한 다양한 프로젝트를 경험하였으며, 자율주행 로봇을 개발한 경험이 있다. 현재 에이아이웍스 Vision AI팀에서 3D Point Cloud를 응용한 Semantic Segmentation 및 Object Detection 개발 연구를 진행하고 있으며, 최근에는 3D Occupancy Prediction을 연구하고 있다.